ChatGPT está evolucionando constantemente. OpenAI, empresa detrás de esta IA, va mejorando los algoritmos y llevando las nuevas versiones a todos los usuarios que, a diario, dependen de esta Inteligencia Artificial. El problema para la empresa llega a la hora de decidir cuánto tiempo mantener las versiones antiguas de los algoritmos, las «legacy», ya que mantenerlas supone un gasto importante para la compañía.

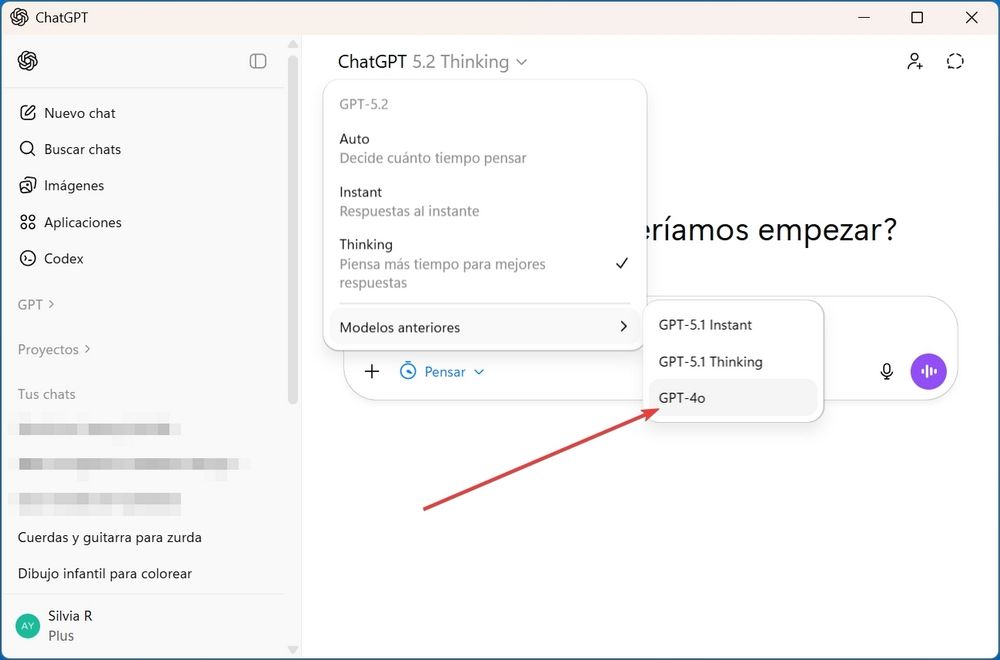

Ahora mismo, el modelo de lenguaje de OpenAI más reciente es GPT 5.2. Esta es la segunda actualización del modelo GPT-5, mucho más precisa, menos robótica y con menor tendencia a las alucinaciones. Sin embargo, aunque este es el modelo más nuevo y el recomendado, hay un importante número de usuarios que sigue usando el modelo GPT-4, en concreto la versión 4o. GPT-4o es, para muchos, una de las mejores versiones de GPT; es la que mejor clava ciertos encargos, como reescrituras sin relleno, resúmenes sin «cheerleading», tono más natural y menos complaciente, etc.

OpenAI defiende que los modelos nuevos (como GPT-5.1 y GPT-5.2) ya han mejorado en personalización y que, dado que el uso de 4o es meramente residual, quieren concentrar los recursos en lo más utilizado. No es la primera vez que OpenAI intenta «jubilar» a GPT-4o, sino que ya lo intentó anteriormente, generando una gran cantidad de quejas y presión en redes. Esto lo llevó a mantenerlo disponible durante un tiempo para ciertos usuarios.

Pero este tiempo toca su fin. Y, tal como explica OpenAI en su blog, el próximo 13 de febrero de 2026, GPT-4o desaparecerá. Junto a él, OpenAI también dirá adiós a otros modelos «legacy», como GPT-4.1, GPT-4.1 mini y OpenAI o4-mini.

| Aspecto clave | GPT-4o | GPT-5.2 | Mejora/Diferencia |

|---|---|---|---|

| Ventana de contexto | 128.000 tokens | 400.000 tokens (con precisión mantenida hasta 256.000) | +212% capacidad; precisión mejorada en contextos profundos |

| Precisión factual / Alucinaciones | Línea base establecida | Reducción del 38% en «tasa de ilusión»; 30% menos errores generales | Reducción de errores significativa; GPT-5.2 Thinking alcanza paridad con expertos humanos en tareas GDPval (44 ocupaciones) |

| Velocidad de respuesta | Línea base | +18% más rápido; latencia reducida reportada por usuarios empresariales | Mejora observable en flujos de trabajo reales; mejor rendimiento en agent routing |

| Razonamiento complejo / Matemáticas | Capacidades base de razonamiento | «Razonamiento de múltiples pasos más afinado»; «rendimiento notablemente más sólido en matemáticas»; ARC-AGI-2: 54,2% (Pro) | Control granular de esfuerzo de razonamiento (nuevos niveles xhigh); mejor rendimiento en problemas abstractos y técnicos |

| Visión multimodal y tool calling | Soporte básico de visión; tool calling funcional | Cruce de referencias texto-imagen mejorado; tool calling del 98,7%; «comportamiento agentivo» avanzado con nuevos parámetros API | Síntesis de información visual-textual más precisa; sistemas de agentes simplificados y más estables |

Cómo prepararnos para el final de GPT-4o

Si como yo eras de los que usabas GPT-40 en lugar de las versiones nuevas de los algoritmos, tienes un problema. Salvo que tengas desplegado un sistema basado en API (ya que la versión de la API no va a desaparecer, por ahora), a partir de la fecha indicada ya no vas a poder seguir usando esta versión de GPT. Por suerte, con un poco de trabajo, es posible blindar nuestros flujos para que el actual GPT-5.2 se comporte lo más parecido posible a lo que esperábamos de 4o. Y te voy a explicar cómo.

- Auditar nuestros prompts clave (los que usamos a diario). Una vez que empecemos a usar GPT-5.2, lo más práctico es coger los 10 o 20 prompts que repetimos siempre (por ejemplo, los que usamos para resúmenes, reescrituras, emails, ideas, código, etc.) y comparar sus resultados con el modelo nuevo. En el proceso, debemos apuntar dónde cambia: ¿mete más relleno? ¿se inventa estructura? ¿añade «framing» innecesario?, y, con estos resultados, podremos ir afinando el nuevo prompt para que sea lo más fiel posible a 4o.

- Crear un modo «compatibilidad 4o» en Personalización. Dentro de ChatGPT tenemos distintas opciones de personalización que nos permiten ajustar la detalle las respuestas de los modelos de lenguaje. Así pues, un truco que funciona especialmente bien es el de guardar un ejemplo del resultado ideal y pedirle a la IA algo como: «hazlo igual de conciso que este ejemplo”. Los nuevos modelos están bastante preparados para este tipo de instrucciones, por lo que el comportamiento que obtendremos será lo más parecido posible al que obteníamos antes.

Alternativas

Si después de ajustar las instrucciones como os hemos explicado seguimos sin sentirnos cómodos, ya solo quedan dos caminos:

- Cambiar de plataforma. GPT-4o ya no va a estar más disponible en ChatGPT. Si por el motivo que sea los modelos más nuevos, como el GPT-5.2, no se adaptan a lo que esperamos ver de ellos, entonces lo que debemos hacer es pasar a usar otras alternativas, como Gemini o Claude. En este punto, la recomendación es obvia: debemos llevar nuestros prompts «de referencia» a estas otras IAs y comparar los resultados que obtenemos con el mismo input.

- Revivir GPT-4o. Esto es algo peligroso. Hay webs, como 4o-Revival, que ofrecen una especie de snapshots del modelo (se trata de una interfaz web para interactuar directamente con la API) que permite replicar las sensaciones de GPT-4o. Eso sí, estas webs suelen tener límites de mensajes y planes de pago. Además, este modelo no es oficial, y conviene ser prudentes con los archivos que subimos o los textos sensibles, ya que todo lo mandamos a un tercero, y no sabemos el uso que puede hacer de ello.