Me ha parecido muy entretenida la revisita que se hace en este vídeo de Veritasium a la paradoja de Newcomb. Personalmente me parece una de las mejores paradojas de todos los tiempos, a la altura de la de Aquiles y la Tortuga o la del Gato de Schrödinger, aunque no tan conocida. La descubrí en una de las columnas de Martin Gardner en Scientific American (julio 1973), cuando releía hacia atrás todos los ejemplares que pude conseguir en el Rastro madrileño. Esta paradoja debe su nombre a que la planteó el físico William Newcomb en 1960; se dio a conocer a través de un ensayo del filósofo Robert Nozick en 1969 y luego Gardner fue quien la popularizó:

En este juego entras en una habitación en la que hay dos cajas. El contenido de la primera (A) es visible y son 1.000 dólares. La otra caja (B) está cerrada y contiene, o bien 1.000.000 dólares, o bien nada. Puedes elegir entre la caja B (la que está cerrada) o ambas cajas, A y B. Un ordenador superinteligente que conoce bien a las personas ha hecho una predicción antes de que entres en la habitación acerca de lo que elegirás, y te consta que siempre ha acertado con todos los participantes anteriores. Si decides quedarte con la caja B, contendrá el millón de dólares. Si eliges ambas cajas, te encontrarás B vacía y sólo podrás llevarte los 1.000 dólares de A. Entras en la habitación: ¿Qué harías?

No hay truquis ni formas de saber qué contiene B ni de manipular el experimento. La complicación del problema de Newcomb se aprecia cuando te das cuenta de que más o menos la mitad de la gente (real) opina que es mejor coger B y el resto que es mejor coger A+B. Y ambos grupos pueden argumentar su postura.

- Los que están a favor de «una sola caja» eligen B y dicen que así ganan un millón de dólares, tal y como enuncia el problema. Fin.

- Los que están a favor de escoger «dos cajas», A y B, argumentan que dado que las cajas ya están preparadas, y en A se puede ver que están los 1.000 dólares, la caja B puede contener 0 o 1.000.000, por lo que abrirla sólo puede igualar o mejorar la situación: o ganas 1.000, o ganas 1.001.000 dólares. Abrir ambas es simplemente quedarte con el máximo que haya, incluso más del millón que se llevan los que eligen solo B.

En el vídeo se introducen algunos conceptos y fórmulas para abordar el problema: el cálculo de la utilidad esperada (premio promedio con cada estrategia), la precisión del superordenador (aunque se supone perfecto) y la imposibilidad de que una decisión futura influya en el pasado (la elección frente a la preparación previa de las cajas), algo que se conoce como dominancia estratégica.

Cómo se manejen estos conceptos lleva a su vez a las dos «escuelas de pensamiento» que dividen a la gente a la hora de decidirse: una centrada en las evidencias (el superordenador siempre acierta) y otra en la causalidad (decisiones futuras no afectan a la preparación previa de las cajas). ¿Lo que calcula el ordenador es correlación o también causalidad?

Luego vienen los saltos filosóficos, como por ejemplo la relación con el libre albedrío: ¿si el ordenador es perfecto al predecir tu comportamiento significa eso que en realidad no tienes libre albedrío, sino que crees tenerlo? ¿Están tus decisiones predeterminadas? También aparecen las cuestiones sobre la racionalidad de cada opción: en la práctica, los que eligen «una sola caja» ganan, lo que refuerza su argumento; en cambio los que eligen «dos cajas» salen peor parados. ¿Merece la pena, en una vuelta de tuerca, cambiar el comportamiento aunque tu argumento esté a favor de las dos cajas?

He echado de menos que no incluyeran la opción de que la decisión se tome al azar, por ejemplo lanzando una moneda al aire. Eso implicaría que el ordenador tiene que ser capaz de predecir qué vas a hacer y además la interacción física de las fuerzas, la gravedad, el rozamiento y rebote de la moneda y todo ese «proceso azaroso». O si lo hicieras con un fenómeno cuántico aleatorio al 50%, que implicaría una paradoja en la predicción al poder predecir algo (supuestamente) impredecible. ¿Podría existir tal ordenador superinteligente? ¿Es como aquello de la fuerza irresistible contra la piedra inamovible? ¿Deriva esa versión cuántica en la teoría de los muchos mundos de Everett?

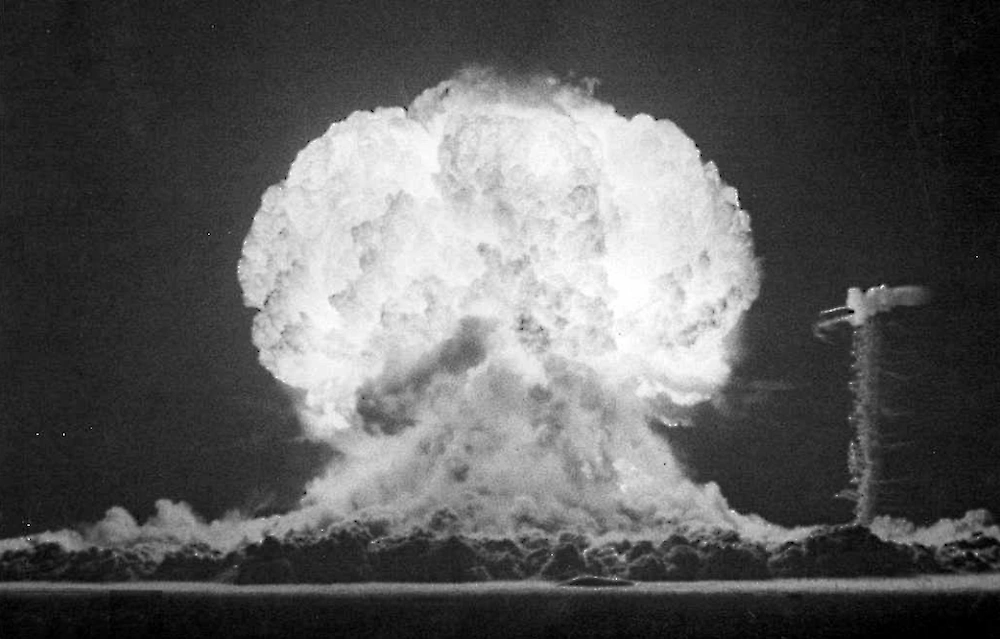

También dicen que esto puede enlazarse con el argumento del «si eres tan listo, por qué no eres rico», un auténtico cierra-bocazas con un toque de falacia; así como con el dilema del prisionero y con la racionalidad en problemas de «compromiso creíble» y disuasión, como el juego del «gallina» o, más a gran escala, la Destrucción Mutua Asegurada (MAD) que hace que las superpotencias no se lancen su arsenal nuclear porque saben que el enemigo respondería con otro tanto y sólo quedarían cucarachas medio chamuscadas. Este sería una especie de dilema del prisionero iterado, con «reputación» y «compromiso», que es como dice la teoría de juegos que ha de ser la estrategia ganadora.

La paradoja/problema de Newcomb bien merece darle mil y una vueltas para saber cómo razona cada uno y, según dicen en el vídeo, «cómo quieres vivir la vida». Algo que parece muy lejos de un experimento mental con un ordenador superinteligente y dinero de mentirijillas pero que encaja en la práctica con muchas situaciones del MundoReal™.

Relacionado: